Mehr über Künstliche Intelligenz

Die Meldung bestimmte sofort die Schlagzeilen weltweit: Am vergangenen Wochenende brachten US-Elitesoldaten den venezolanischen Machthaber Nicolás Maduro gewaltsam in die Vereinigten Staaten, wo der Diktator jetzt wegen „Drogen-Terrorismus“ vor Gericht steht. Der Militärschlag in Caracas hat unmittelbar auch KI-Kreatoren animiert. Vor allem in einem Genre tobten sie sich aus: Tanz-Videos.

Schnell waren die sozialen Medien voller solcher Clips. In einem sieht man Maduro tanzend in einer Zelle, die er sich mit dem wegen Sexhandels verurteilten Rapper Sean „Diddy“ Combs teilt. In einem anderen Video tanzt er synchron mit dem oberkörperfreien Donald Trump im Oval Office. Hier ist schnell klar, dass es sich nicht um reale Filme, sondern um KI-Schöpfungen handelt.

Schwieriger war das bei nachrichtlich anmutenden Bildern, die in großer Zahl in den sozialen Medien kursierten. Einige entpuppten sich ebenfalls als KI-Fake, wie beispielsweise die Faktenchecker:innen von „New York Times“, dpa, Heise, Correctiv, der European Broadcasting Union oder der „Faktenfuchs“-Redaktion des BR darlegten.

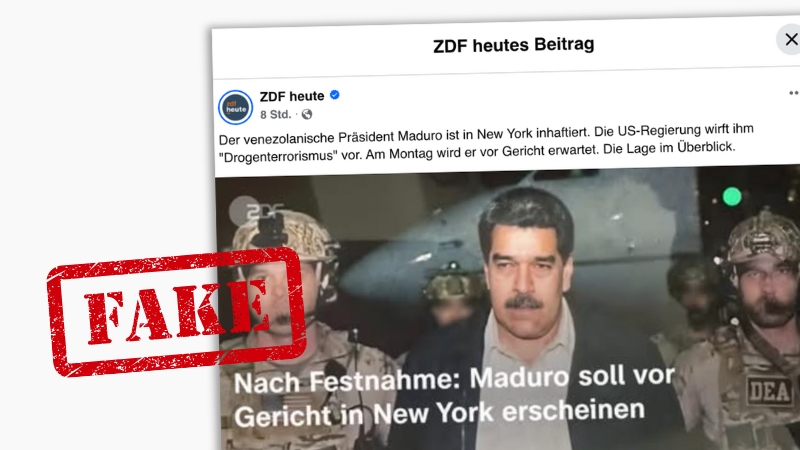

Das Phänomen blieb aber nicht auf soziale Plattformen beschränkt. Auch renommierte Medien verbreiteten höchstwahrscheinlich KI-Fälschungen in ihren Beiträgen. Eine nächtliche „Aufnahme“ des venezolanischen Autokraten zwischen zwei angeblichen US-Soldaten vor einem Flugzeug etwa fand sich in einem inzwischen überarbeiteten Facebook-Post des ZDF wieder (hier in der ursprünglichen Fassung archiviert).

Die Nachrichtenagentur AFP hatte das Bild für einen Faktencheck nach eigenen Angaben „mit mehreren KI-Erkennungstools untersucht“ und war schließlich mittels umgekehrter Bildsuche bei Google zu dem Ergebnis gekommen, dass das Motiv von einer Google-KI erstellt worden sei. Die vom ZDF angegebene Bildquelle verwies auf „ddp/Polaris“, zwei bekannte Bildagenturen also.

Etliche Zeitungen der Funke-Mediengruppe – darunter die „Berliner Morgenpost“, die „Westfalenpost“, die „Thüringer Allgemeine“ und das „Hamburger Abendblatt“ – hatten ein zweites Bild publiziert, das AFP ebenfalls als KI-Schöpfung einstufte. Es zeigte Maduro mit blutverschmiertem Hemd, in den Funke-Titeln erschien es online sowie teilweise als Seitenaufmacher der Printausgaben von diesem Montag.

Nach einer Anfrage der Agentur AFP bei Funke veröffentlichten die betroffenen Titel am Dienstag einen Korrekturhinweis:

„Wie sich nachträglich herausgestellt hat, handelte es sich um ein von Künstlicher Intelligenz erstelltes Foto, das nicht authentisch war. Das Bild wurde von der Foto-Agentur ddp verbreitet, mit der wir – wie viele andere Redaktionen auch – seit vielen Jahren zusammenarbeiten. Das Verwenden von KI-generierten Nachrichtenfotos entspricht nicht unseren redaktionellen Richtlinien und wir bedauern diesen Vorfall außerordentlich. Die genauen Hintergründe dieses Fehlers werden wir gemeinsam mit der Agentur aufklären. Bis dahin verzichten wir auf die Veröffentlichung von ddp-Fotomaterial und werden in einem gesonderten Beitrag den Vorgang, aber auch unseren redaktionellen Umgang mit der Künstlichen Intelligenz eingehend darstellen.“

Die Funke-Publikationen gingen also erstmal offensiv und transparent mit dem Vorgang um – anders als das ZDF, bei dem kein entsprechender Hinweis auf den Austausch des Bildes zu finden war.

Doch wie kam es überhaupt zur Verbreitung der Bilder? Bei der ddp media GmbH war man selbst überrascht, als man am Dienstag durch einen Anruf aus der Funke-Gruppe von dem KI-Vorwurf erfuhr. Die Bildagentur hat ihren Sitz in Hamburg und gehört seit einigen Jahren zur Bildagentur Action Press.

Zwei Fotos habe ddp verbreitet, die „angeblich“ KI-generiert oder zumindest KI-bearbeitet waren, sagt Geschäftsführer Ulli Michel im Telefonat mit Übermedien. Das Foto, das die Funke-Titel verwendet haben, und das andere Foto, das auch im ZDF-Post zu sehen war. Die Formulierung „angeblich“ verwendet er, weil man bei der Agentur selbst noch nicht mit Sicherheit sagen kann, woher die Bilder ursprünglich stammen. Aber: „Zu 99 Prozent sind es KI-Bilder“, so Michel.

Der ddp-Chef beschreibt eine Breaking-News-Situation, in der es schnell gehen musste: Die Nachricht von der US-Aktion in Caracas kam überraschend am Wochenende, zügig mussten Bilder zu den Kunden. Die renommierte New Yorker Fotoagentur Polaris, mit der ddp und Action Press seit Jahrzehnten zusammenarbeiten, hatte Material von der Gefangennahme Maduros im Angebot.

Die ddp-Redaktion habe die Bilder in der gebotenen Geschwindigkeit händisch geprüft – sie wurden demnach also nicht automatisiert von der Partneragentur übernommen, sondern in Augenschein genommen. Dabei habe die Redaktion jedoch keine Probleme bemerkt und sie schließlich über den eigenen Dienst den ddp-Kunden angeboten. Er habe die Polaris-Leitung anschließend um Informationen gebeten, sagt Michel: „Wir wollen eine lückenlose Aufklärung. Vor allem wollen wir wissen, was die Quelle ist.“ Eine inhaltliche Rückmeldung sei bis zum Donnerstagnachmittag deutscher Zeit noch nicht eingegangen.

Ulli Michel macht deutlich, dass KI-generierte „Nachrichtenbilder“ nicht im Einklang mit den Standards von ddp stünden. Noch nicht einmal mit einer Kennzeichnung des künstlichen Ursprungs habe man KI-erstellte Motive verschickt. Sollte sich der Fake-Verdacht abschließend bestätigen, sei man betrogen worden, sagt er.

Der Agenturchef sieht aber auch ein größeres und grundsätzlicheres Problem, weil es bisher keine Software gebe, die KI-Bilder zuverlässig entlarve. Tatsächlich erkennt beispielsweise Googles Dienst SynthID bisher nur Werke von Google-eigenen KIs. Die Software, mit der nach eigenen Angaben auch einige der Faktencheck-Redaktionen gearbeitet hatten, untersucht potenzielle KI-Bilder auf entsprechende Wasserzeichen, die den künstlichen Ursprung entlarven – allerdings bisher eben nicht universell für alle denkbaren Foto-KIs.

ddp und Polaris müssen sich aber schon die Frage gefallen lassen, ob sie vor der Verbreitung nicht dieselben Möglichkeiten zur Echtheitsprüfung gehabt hätten wie AFP im nachträglichen Faktencheck. AFP nutzte das KI-Erkennungstool InVID WeVerif und untersuchte zudem das Bild auf visuelle Unstimmigkeiten.

Im Gespräch mit Übermedien wählt Michel drastische Worte: „Die Branche muss sich daran gewöhnen, dass unser Geschäftsmodell – authentische Bilder zu den Kunden zu bringen – durch die KI bedroht ist“, sagt er. „Es ist eine Riesengefahr, dass uns KI-generiertes Material untergejubelt wird.“

Noch unbekannt ist, wer für die mutmaßlichen Fälschungen verantwortlich ist. Eine Nachricht von Übermedien an die Bildagentur Polaris in New York blieb bisher ohne Antwort. Auch die Funke-Mediengruppe antwortete nicht auf unsere Anfrage.

Deren Zeitungen veröffentlichten allerdings am Donnerstag einen weiteren Text „in eigener Sache“. Unter der Überschrift „Gefälschtes Maduro-Foto: Wie es dazu kam – und was die Lehren sind“ beschreiben sie ihren Leser:innen, welche Bilderflut in kürzester Zeit über die Redaktion gekommen sei:

„Am Samstagmorgen melden auch die Nachrichtenagenturen in Deutschland die Explosionen in der venezolanischen Hauptstadt. In den Stunden danach erreichen unsere und andere Redaktionen etliche Fotos aus dem Land. Am Ende des Wochenendes werden es etwa 10.000 Bilder sein.“

Weil niemand überall auf der Welt „eigene Fotoreporter vor Ort“ habe, verlasse man sich auf die Sorgfalt etablierter Bildagenturen, erklären die Funke-Redaktionen ihrem Publikum. Deutlich vager bleiben sie bei den angekündigten „Lehren“. Dass sie welche ziehen möchten, wird klar – aber welche, das scheint noch unklar zu sein:

„Unser Verlag hat sich für den Umgang mit Künstlicher Intelligenz Richtlinien gegeben, mit der die journalistische Qualität gesichert wird. Sorgfalt steht an erster Stelle, heißt es darin. Diesem Ziel fühlen wir uns mehr denn je verpflichtet und werden Konsequenzen aus dem Fall ziehen, neue Sicherungen einbauen und Sie darüber transparent informieren.“

So zeigt der Fall Maduro vor allem, wie groß die Ratlosigkeit ist. Ein Partner verlässt sich auf den anderen, doch den enormen Aufwand, potenzielle KI-Fälschungen nachzurecherchieren, kann derzeit anscheinend kaum jemand leisten – jedenfalls nicht vor der Veröffentlichung. Zu groß die Bilderflut, zu täuschend echt die Ergebnisse der KI – und zu wenig etabliert und ausgereift die technischen Lösungen. Auf ihnen liegt die große Hoffnung: Die KI soll es richten, den KI-Fakes auf die Schliche zu kommen.

Sie sehen gerade einen Platzhalterinhalt von Turnstile. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenSie sehen gerade einen Platzhalterinhalt von Facebook. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenSie sehen gerade einen Platzhalterinhalt von Instagram. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenSie sehen gerade einen Platzhalterinhalt von X. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr Informationen

Ich habe da schon sehr große Zweifel dass KI-Fakes mit KI entlarvt werden sollen. Bin da zwar nicht so tief im Thema drin, aber es hört sich eher nach mehr Problemen an.

Ich habe von einer Verifizierung von echten Bildern gehört mit einer Art digitalen Fingerabdruck. Das hört sich für mich zumindest sinnvoller an.

Man sieht ja an dem Maduro Beispiel sehen, und es sich vielleicht auch denken, die Menge der Fake Bilder wird die originale um ein Vielfaches übersteigen.

„„Die Branche muss sich daran gewöhnen, dass unser Geschäftsmodell – authentische Bilder zu den Kunden zu bringen – durch die KI bedroht ist“

Ist nicht eben das das „Geschäftsmodell“, gesichert authentische Bilder statt KI-generiertes Material zu liefern? Natürlich erfordert das Sorgfalt und kostet Geld und Zeit. Aber „echte“ Bilder haben eben auch ihren Preis. Und es sollte nach wie vor ein Interesse daran geben – und in Folge dessen einen Markt dafür.

Nur der Korrektheit wegen: Maduro wurde nicht „verhaftet“, auch wenn die US-Regierung das so nennt. Man kann das Oberhaupt eines anderen Landes völkerrechtlich gesehen nicht in seiner eigenen Hauptstadt verhaften. Man sollte den Trumpschen Sprachgebrauch nicht auch noch in die Überschrift übernehmen, der ist in Bezug auf die Realität genauso Fake wie die KI-Bilder.

Wie haben denn Bildagenturen vor KI gearbeitet? KI ist ja nur die neuste Möglichkeit von vielen, Bilder (oder deren Kontext) zu manipulieren. Bilder konnten schon immer gestellt, zugeschnitten, retouchiert oder einfach aus ihrem Zusammenhang gerissen werden. Ändert KI da wirklich soviel?

Zu #3:

Vielen Dank für den Hinweis! Da haben Sie recht! Wir haben die Überschrift geändert.